Ініціалізація контексту в ентропійному кодуванні

Номер патенту: 114674

Опубліковано: 10.07.2017

Автори: Нгуєн Тунг, Бросс Бенджамін, Георге Валері, Зікманн Міша, Марпе Детлеф, Штегеманн Ян, Прайсс Маттіас, Кірххоффер Хайнер, Віганд Томас

Формула / Реферат

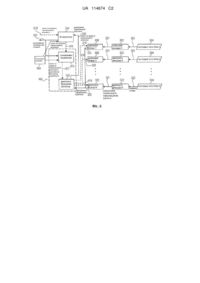

1. Декодер для декодування масиву інформаційних зразків з потоку даних (401), у якому синтаксичні елементи кодовані з використанням бінаризацій синтаксичних елементів (327), який містить ентропійний декодер (409), сконфігурований для одержання ряду інформаційних величин (326) бінаризацій з потоку даних (401) з використанням бінарного ентропійного декодування шляхом вибору контексту серед різних контекстів і шляхом оновлення станів ймовірності, які зв'язані з різними контекстами і вказують найбільш ймовірний символ серед 0 та 1 і ймовірність найменш ймовірного символу, в залежності від попередньо декодованих частин потоку даних (401);

десимволізатор (314), сконфігурований для дебінаризації результатів бінаризацій синтаксичних елементів (327) для одержання цілих величин синтаксичних елементів;

реконструктор (404), сконфігурований для відновлення масиву інформаційних зразків на основі цілих величин синтаксичних елементів з використанням параметра дискретизації, при цьому ентропійний декодер (409) сконфігурований для розрізнення 126 станів ймовірності і для ініціалізації станів ймовірності, зв'язаних з різними контекстами, згідно з лінійним рівнянням ![]() параметра дискретизації QР, де а є крутизною, a d є зміщенням лінійної функції, і

параметра дискретизації QР, де а є крутизною, a d є зміщенням лінійної функції, і ![]() вказує ймовірність наперед визначеного символу серед 1 або 0 таким чином, що визначення, чи перевищує

вказує ймовірність наперед визначеного символу серед 1 або 0 таким чином, що визначення, чи перевищує ![]() 63, безпосередньо вказує, чи є 0 або 1 найбільш ймовірним символом, при цьому ентропійний декодер сконфігурований для одержання для кожного з різних контекстів крутизни а і зміщення d лінійного рівняння з першої і другої чотирибітової частини відповідної 8-бітової ініціалізуючої величини.

63, безпосередньо вказує, чи є 0 або 1 найбільш ймовірним символом, при цьому ентропійний декодер сконфігурований для одержання для кожного з різних контекстів крутизни а і зміщення d лінійного рівняння з першої і другої чотирибітової частини відповідної 8-бітової ініціалізуючої величини.

2. Декодер за п. 1, який відрізняється тим, що ентропійний декодер (409) сконфігурований для виконання оновлення стану ймовірності для на даний момент одержаної інформаційної величини для переходу з поточного стану ймовірності, зв'язаного з контекстом, вибраним для на даний момент одержаної інформаційної величини в 126 станах ймовірності, до нового стану ймовірності серед 126 станів ймовірності в залежності від на даний момент одержаної інформаційної величини.

3. Декодер за п. 1 або п. 2, який відрізняється тим, що ентропійний декодер (409) сконфігурований для бінарного арифметичного декодування на даний момент одержаної інформаційної величини шляхом дискретизації величини ширини поточного інтервалу ймовірності, яка представляє поточний інтервал ймовірності, для одержання індексу інтервалу ймовірності і шляхом виконання підрозбиття інтервалу шляхом індексування вхідної величини таблиці серед вхідних величин таблиці з використанням індексу інтервалу ймовірності і індексу стану ймовірності в залежності від поточного стану ймовірності, зв'язаного з контекстом, вибраним для на даний момент одержаної інформаційної величини для одержання підрозбиття поточного інтервалу ймовірності на два часткові інтервали, і при цьому ентропійний декодер (409) сконфігурований для вибору серед двох часткових інтервалів на основі величини стану зміщення з внутрішньої частини поточного інтервалу ймовірності, для оновлення величини ширини інтервалу ймовірності і величини стану зміщення, і для виведення величини на даний момент одержаної інформаційної величини, використовуючи вибраний частковий інтервал, і для виконання повторної нормалізації оновленої величини ширини інтервалу ймовірності і величини стану зміщення, включаючи продовження зчитування бітів з потоку даних (401).

4. Декодер за будь-яким із пп. 1-3, який відрізняється тим, що масив інформаційних зразків є картою глибини.

5. Спосіб декодування масиву інформаційних зразків з потоку даних, у якому кодуються синтаксичні елементи з використанням результатів бінаризацій синтаксичних елементів, у якому одержують ряд інформаційних величин результатів бінаризацій з потоку даних з використанням бінарного ентропійного декодування шляхом вибору контексту серед різних контекстів і шляхом оновлення станів ймовірності, які зв'язані з різними контекстами і вказують найбільш ймовірний символ серед 0 та 1 і ймовірність найменш ймовірного символу, в залежності від попередньо декодованих частин потоку даних;

дебінаризують дані бінаризацій синтаксичних елементів для одержання цілих величин синтаксичних елементів;

відновлюють масив інформаційних зразків на основі цілих величин синтаксичних елементів з використанням параметра дискретизації,

при цьому одержання ряду інформаційних величин результатів бінаризацій розрізняють в 126 станах ймовірності і ініціалізують стани ймовірності, зв'язані з різними контекстами, згідно з лінійним рівнянням ![]() параметра дискретизації QP , де а є крутизною, a d є зміщенням лінійної функції, і

параметра дискретизації QP , де а є крутизною, a d є зміщенням лінійної функції, і ![]() вказує ймовірність наперед визначеного символу серед 1 або 0 таким чином, що визначення, чи перевищує

вказує ймовірність наперед визначеного символу серед 1 або 0 таким чином, що визначення, чи перевищує ![]() 63, безпосередньо вказує, чи є 0 або 1 найбільш ймовірним символом, і для кожного з різних контекстів одержують крутизну а і зміщення d лінійного рівняння з першої і другої чотирибітової частини відповідної 8-бітової ініціалізуючої величини.

63, безпосередньо вказує, чи є 0 або 1 найбільш ймовірним символом, і для кожного з різних контекстів одержують крутизну а і зміщення d лінійного рівняння з першої і другої чотирибітової частини відповідної 8-бітової ініціалізуючої величини.

6. Спосіб за п. 5, який відрізняється тим, що одержання ряду інформаційних величин конфігурують для виконання оновлення стану ймовірності для на даний момент одержаної інформаційної величини для переходу з поточного стану ймовірності, зв'язаного з контекстом, вибраним для на даний момент одержаної інформаційної величини в 126 станах ймовірності, до нового стану ймовірності серед 126 станів ймовірності в залежності від на даний момент одержаної інформаційної величини.

7. Спосіб за п. 5 або п. 6, який відрізняється тим, що одержання ряду інформаційних величин конфігурують для бінарного арифметичного декодування на даний момент одержаної інформаційної величини шляхом дискретизації величини ширини поточного інтервалу ймовірності, яка представляє поточний інтервал ймовірності, для одержання індексу інтервалу ймовірності і шляхом виконання підрозбиття інтервалу шляхом індексування вхідної величини таблиці серед вхідних величин таблиці з використанням індексу інтервалу ймовірності і індексу стану ймовірності в залежності від поточного стану ймовірності, зв'язаного з контекстом, вибраним для на даний момент одержаної інформаційної величини для одержання підрозбиття поточного інтервалу ймовірності на два часткові інтервали, і при цьому одержання ряду інформаційних величин конфігурують для вибору серед двох часткових інтервалів на основі величини стану зміщення з внутрішньої частини поточного інтервалу ймовірності, для оновлення величини ширини інтервалу ймовірності і величини стану зміщення, і для виведення величини на даний момент одержаної інформаційної величини, використовуючи вибраний частковий інтервал, і для виконання повторної нормалізації оновленої величини ширини інтервалу ймовірності і величини стану зміщення, включаючи продовження зчитування бітів з потоку даних (401).

8. Спосіб за будь-яким із пп. 5-7, який відрізняється тим, що масив інформаційних зразків є картою глибини.

9. Кодер для кодування масиву інформаційних зразків з одержанням потоку даних шляхом кодування синтаксичних елементів з одержанням потоку даних з використанням бінаризацій синтаксичних елементів, який містить конструктор, сконфігурований для представлення масиву інформаційних зразків шляхом визначення цілих величин синтаксичних елементів в залежності від параметра дискретизації, символізатор, сконфігурований для бінаризації цілих величин синтаксичних елементів для одержання даних бінаризацій синтаксичних елементів;

ентропійний кодер, сконфігурований для кодування ряду інформаційних величин процесів бінаризацій з одержанням потоку даних з використанням бінарного ентропійного кодування шляхом вибору контексту серед різних контекстів і шляхом оновлення станів ймовірності, які зв'язані з різними контекстами і вказують найбільш ймовірний символ серед 0 та 1 і ймовірність найменш ймовірного символу, в залежності від попередньо кодованих частин потоку даних;

при цьому ентропійний кодер сконфігурований для розрізнення 126 станів ймовірності і для ініціалізації станів ймовірності, зв'язаних з різними контекстами, згідно з лінійним рівнянням ![]() параметра дискретизації QP, де а є крутизною, a d є зміщенням лінійної функції, і

параметра дискретизації QP, де а є крутизною, a d є зміщенням лінійної функції, і ![]() вказує ймовірність наперед визначеного символу серед 1 або 0 таким чином, що визначення, чи перевищує

вказує ймовірність наперед визначеного символу серед 1 або 0 таким чином, що визначення, чи перевищує ![]() 63, безпосередньо вказує, чи є 0 або 1 найбільш ймовірним символом, і при цьому ентропійний кодер сконфігурований для одержання для кожного з різних контекстів крутизни а і зміщення d лінійного рівняння з першої і другої чотирибітової частини відповідної 8-бітової ініціалізуючої величини.

63, безпосередньо вказує, чи є 0 або 1 найбільш ймовірним символом, і при цьому ентропійний кодер сконфігурований для одержання для кожного з різних контекстів крутизни а і зміщення d лінійного рівняння з першої і другої чотирибітової частини відповідної 8-бітової ініціалізуючої величини.

10. Кодер за п. 9, який відрізняється тим, що ентропійний кодер сконфігурований для виконання оновлення стану ймовірності для на даний момент кодованої інформаційної величини шляхом переходу від поточного стану ймовірності, зв'язаного з контекстом, вибраним для на даний момент кодованої інформаційної величини в 126 станах ймовірності, до нового стану ймовірності серед 126 станів ймовірності в залежності від поточно кодованої інформаційної величини.

11. Кодер за п. 9 або п. 10, який відрізняється тим, що ентропійний кодер сконфігурований для бінарного арифметичного кодування на даний момент кодованої інформаційної величини шляхом дискретизації величини ширини поточного інтервалу ймовірності, яка представляє поточний інтервал ймовірності, для одержання індексу інтервалу ймовірності і шляхом виконання підрозбиття інтервалу шляхом індексування вхідної величини таблиці серед вхідних величин таблиці з використанням індексу інтервалу ймовірності і індексу стану ймовірності, який залежить від поточного стану ймовірності, зв'язаного з контекстом, вибраним для поточно кодованої інформаційної величини для одержання підрозбиття поточного інтервалу ймовірності на два часткові інтервали, і при цьому ентропійний кодер сконфігурований для вибору серед двох часткових інтервалів на основі цілої величини поточно кодованої інформаційної величини, для оновлення величини ширини інтервалу ймовірності і зміщення інтервалу ймовірності з використанням вибраного часткового інтервалу, і для виконання повторної нормалізації величини ширини інтервалу ймовірності і зміщення інтервалу ймовірності, включаючи продовження запису бітів в потік даних.

12. Кодер за будь-яким із пп. 9-11, який відрізняється тим, що масив інформаційних зразків є картою глибини.

13. Спосіб кодування масиву інформаційних зразків з одержанням потоку даних шляхом кодування синтаксичних елементів з одержанням потоку даних з використанням результатів бінаризацій синтаксичних елементів, у якому представляють масив інформаційних зразків шляхом визначення цілих величин синтаксичних елементів в залежності від параметра дискретизації, бінаризують цілі величини синтаксичних елементів для одержання результатів бінаризацій синтаксичних елементів;

кодують ряд інформаційних величин результатів бінаризацій з одержанням потоку даних з використанням бінарного ентропійного кодування шляхом вибору контексту серед різних контекстів і шляхом оновлення станів ймовірності, які зв'язані з різними контекстами і вказують найбільш ймовірний символ серед 0 та 1 і ймовірність найменш ймовірного символу, в залежності від попередньо кодованих частин потоку даних;

при цьому кодування з використанням бінарного ентропійного кодування розрізняють в 126 станах ймовірності і ініціалізують стани ймовірності, зв'язані з різними контекстами, згідно з лінійним рівнянням ![]() параметра дискретизації QP , де а є крутизною, a d є зміщенням лінійної функції, і

параметра дискретизації QP , де а є крутизною, a d є зміщенням лінійної функції, і ![]() вказує ймовірність наперед визначеного символу серед 1 або 0 таким чином, що визначення, чи перевищує

вказує ймовірність наперед визначеного символу серед 1 або 0 таким чином, що визначення, чи перевищує ![]() 63, безпосередньо вказує, чи є 0 або 1 найбільш ймовірним символом, і одержують для кожного з різних контекстів крутизну а і зміщення d лінійного рівняння з першої і другої чотирибітової частини відповідної 8-бітової ініціалізуючої величини.

63, безпосередньо вказує, чи є 0 або 1 найбільш ймовірним символом, і одержують для кожного з різних контекстів крутизну а і зміщення d лінійного рівняння з першої і другої чотирибітової частини відповідної 8-бітової ініціалізуючої величини.

14. Спосіб кодування за п. 13, який відрізняється тим, що кодування ряду інформаційних величин конфігурують для виконання оновлення стану ймовірності для на даний момент кодованої інформаційної величини для переходу з поточного стану ймовірності, зв'язаного з контекстом, вибраним для на даний момент кодованої інформаційної величини в 126 станах ймовірності, до нового стану ймовірності серед 126 станів ймовірності в залежності від на даний момент кодованої інформаційної величини.

15. Спосіб кодування за п. 13 або п. 14, який відрізняється тим, що кодування ряду інформаційних величин конфігурують для бінарного арифметичного декодування на даний момент кодованої інформаційної величини шляхом дискретизації величини ширини поточного інтервалу ймовірності, яка представляє поточний інтервал ймовірності, для одержання індексу інтервалу ймовірності і шляхом виконання підрозбиття інтервалу шляхом індексування вхідної величини таблиці серед вхідних величин таблиці з використанням індексу інтервалу ймовірності і індексу стану ймовірності, який залежить від поточного стану ймовірності, зв'язаного з контекстом, вибраним для на даний момент кодованої інформаційної величини для одержання підрозбиття поточного інтервалу ймовірності на два часткові інтервали, і при цьому кодування ряду інформаційних величин конфігурують для вибору серед двох часткових інтервалів на основі цілої величини на даний момент кодованої інформаційної величини, для оновлення величини ширини інтервалу ймовірності і зміщення інтервалу ймовірності, використовуючи вибраний частковий інтервал, і для виконання повторної нормалізації величини ширини інтервалу ймовірності і зміщення інтервалу ймовірності, включаючи продовження запису бітів в потік даних.

16. Спосіб кодування за будь-яким із пп. 13-15, який відрізняється тим, що масив інформаційних зразків є картою глибини.

17. Носій цифрових даних, який зберігає потік даних (401), у який кодують масив інформаційних зразків за допомогою синтаксичних елементів, які кодуються в потік даних з використанням результатів бінаризацій синтаксичних елементів (327) таким чином, що під час декодування масиву інформаційних зразків з потоку даних одержують ряд інформаційних величин результатів бінаризацій з потоку даних з використанням бінарного ентропійного декодування шляхом вибору контексту серед різних контекстів і шляхом оновлення станів ймовірності, які зв'язані з різними контекстами і вказують найбільш ймовірний символ серед 0 та 1 і ймовірність найменш ймовірного символу, в залежності від попередньо декодованих частин потоку даних;

дебінаризують дані бінаризацій синтаксичних елементів для одержання цілих величин синтаксичних елементів;

відновлюють масив інформаційних зразків на основі цілих величин синтаксичних елементів з використанням параметра дискретизації, при цьому одержання ряду інформаційних величин результатів бінаризацій розрізняють в 126 станах ймовірності і ініціалізують стани ймовірності, зв'язані з різними контекстами, згідно з лінійним рівнянням ![]() параметра дискретизації QP , де а є крутизною, a d є зміщенням лінійної функції, і

параметра дискретизації QP , де а є крутизною, a d є зміщенням лінійної функції, і ![]() вказує ймовірність наперед визначеного символу серед 1 або 0 таким чином, що визначення, чи перевищує

вказує ймовірність наперед визначеного символу серед 1 або 0 таким чином, що визначення, чи перевищує ![]() 63, безпосередньо вказує, чи є 0 або 1 найбільш ймовірним символом, і одержують для кожного з різних контекстів крутизну а і зміщення d лінійного рівняння з першої і другої чотирибітової частини відповідної 8-бітової ініціалізуючої величини.

63, безпосередньо вказує, чи є 0 або 1 найбільш ймовірним символом, і одержують для кожного з різних контекстів крутизну а і зміщення d лінійного рівняння з першої і другої чотирибітової частини відповідної 8-бітової ініціалізуючої величини.

18. Носій цифрових даних за п. 17, який відрізняється тим, що потік даних є об'єднанням пакетів даних

19. Носій цифрових даних за п. 17, який відрізняється тим, що масив інформаційних зразків є картою глибини.

Текст