Пристрій багатошарової асоціативної пам’яті з керуючими нейронами

Номер патенту: 108712

Опубліковано: 25.05.2015

Автори: Заковоротний Олександр Юрійович, Дмитрієнко Валерій Дмитрович, Хавіна Інна Петрівна, Бречко Вероніка Олександрівна

Формула / Реферат

Пристрій багатошарової асоціативної пам'яті з керуючими нейронами, який складається з двох сенсорних шарів нейронів вхідного й вихідного, (N-1) проміжних шарів обробляючих нейронів, кожен нейрон вхідного шару з'єднаний з кожним обробляючим нейроном першого проміжного шару вихідними зв'язками, кожен обробляючий нейрон кожного проміжного шару з'єднаний з кожним обробляючим нейроном наступного проміжного шару вихідними зв'язками, кожен обробляючий нейрон останнього проміжного шару з'єднаний з кожним нейроном вихідного шару вихідними зв'язками, який відрізняється тим, що у вхідний та всі проміжні шари обробляючих нейронів введені керуючі нейрони, кожен керуючий нейрон вхідного шару з'єднаний з кожним обробляючим нейроном першого проміжного шару вихідними зв'язками, кожен керуючий нейрон кожного проміжного шару пов'язаний з кожним обробляючим нейроном наступного шару вихідними зв'язками, кожен керуючий нейрон останнього проміжного шару пов'язаний з кожним обробляючим нейроном вихідного шару вихідними зв'язками.

Текст

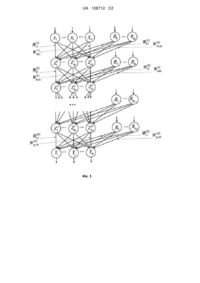

Реферат: Пристрій багатошарової асоціативної пам'яті з керуючими нейронами може бути використаний при побудові баз знань технологічних процесів та систем підтримки прийняття рішень. Розроблений пристрій може будувати асоціації з урахуванням керуючих даних завдяки тому, що в структуру мережі було введено шари керуючих нейронів. Розроблений пристрій здатен зберігати та відновлювати зі своєї пам'яті асоціативні зображення та будувати ланки асоціацій з урахуванням додаткових даних. UA 108712 C2 (12) UA 108712 C2 UA 108712 C2 5 10 15 20 25 30 35 40 45 50 55 Винахід належить до обчислювальної техніки, зокрема до області побудови автоматизованих систем керування та діагностики складних технічних об'єктів. Винахід може бути використаний при побудові систем керування або діагностики такого складного технічного об'єкта як дизель-поїзд з тяговими асинхронними електроприводами. Відомий пристрій гетероасоціативної пам'яті складається з двох шарів нейронів та однонаправлених зв'язками між ними. Якщо в мережі число вхідних нейронів більше числа вихідних, то мережа може використовуватись як гетероасоціативна пам'ять, а якщо в мережі число вхідних нейронів рівне числу вихідних, то мережа використовується як автоасоціативна пам'ять [1]. Недоліком даного пристрою є неможливість коригування результатів за допомогою керуючих нейронів. Відомий пристрій двонаправленої асоціативної пам'яті, що складається з двох сенсорних шарів нейронів та відрізняється тим, що в нього уведені два керуючі нейрони, зв'язані вихідними зв'язками з керуючими нейронами відповідних модулів та вхідними зв'язками з усіма нейронами в проміжному шарі, елементи якого зв'язані парами двонаправлених зважених зв'язків з відповідними їм елементами розпізнавальних шарів двох однотипних паралельно працюючих модулів, кожний з яких являє собою дискретну нейронну мережу адаптивної резонансної теорії, що містить у собі шари інтерфейсних елементів, нейрони яких пов'язані з відповідними їм елементами сенсорних шарів парами бінарних двонаправлених зв'язків, шари розпізнавальних елементів, нейрони яких пов'язані з кожним з елементів у відповідних їм інтерфейсних шарах парами двонаправлених зважених зв'язків з безперервними ваговими коефіцієнтами, вирішуючи нейрони, які зв'язані збудливими вхідними зв'язками з усіма елементами сенсорних шарів, гальмуючими вхідними зв'язками з усіма елементами інтерфейсних шарів та збудливими вихідними зв'язками з усіма елементами розпізнавальних шарів й керуючи нейрони модулів, які зв'язані збудливими вхідними зв'язками з усіма елементами сенсорних шарів, збудливими вихідними зв'язками з усіма елементами інтерфейсних шарів та гальмуючими вхідними зв'язками з усіма елементами розпізнавальних шарів, а також зв'язані вхідними зв'язками з відповідними керуючими нейронами мережі [2]. У порівнянні з попереднім аналогом, даний пристрій містить керуючі нейрони. Однак недоліком розглянутого пристрою є складність його апаратної реалізації та неможливість побудови ланцюгів асоціацій. Найбільш близьким до заявленого пристрою є пристрій нейронної мережі, що складається з шару вхідних нейронів, шару вихідних нейронів та (N-1) шарів нейронів між ними, що послідовно з'єднані один з одним вихідними зв'язками [3]. При порівнянні з відомими аналогами пристрій-прототип (нейронна мережа) здатен відновлювати ланцюги асоціацій зі своєї пам'яті, але у нього відсутня можливість коригування результатів за допомогою керуючих нейронів, тобто по одному вхідному зображенню отримувати декілька асоціативних в залежності від даних керуючих нейронів. Таким чином, недоліком прототипу є те, що він не в змозі отримувати декілька асоціативних зображень одному вхідному зображенню в залежності від даних керуючих нейронів. Задача винаходу - розробка пристрою асоціативної пам'яті, що має можливістю побудови асоціацій з урахуванням додаткової інформації з керуючих нейронів. Задача вирішується завдяки тому, що пристрій багатошарової нейронної мережі перебудовується шляхом введення в структуру мережі (N-1) проміжних шарів обробляючих нейронів, кожен нейрон вхідного шару з'єднаний з кожним обробляючим нейроном першого проміжного шару вихідними зв'язками, кожен обробляючий нейрон кожного проміжного шару з'єднаний з кожним обробляючим нейроном наступного проміжного шару вихідними зв'язками, кожен обробляючий нейрон останнього проміжного шару з'єднаний з кожним нейроном вихідного шару вихідними зв'язками, та відрізняється тим, що у вхідний та всі проміжні шари обробляючих нейронів введено керуючі нейрони, кожен керуючий нейрон вхідного шару з'єднаний з кожним обробляючим нейроном першого проміжного шару вихідними зв'язками, кожен керуючий нейрон кожного проміжного шару пов'язаний з кожним обробляючим нейроном наступного шару вихідними зв'язками, кожен керуючий нейрон останнього проміжного шару пов'язаний з кожним обробляючим нейроном вихідного шару вихідними зв'язками. У результаті додавання в структуру нейронної мережі перерахованих вище керуючих нейронів досягається можливість побудови асоціацій з урахуванням додаткової інформації. Це стає можливим завдяки тому, що керуючі нейрони пов'язані з шарами нейронної мережі і при поданні інформації на будь-який з шарів, отримуємо скориговані асоціативні дані з урахуванням інформації керуючих нейронів. 1 UA 108712 C2 Винахід пояснюється кресленням (фіг. 1), на якому наведена схема пристрою багатошарової асоціативної пам'яті з керуючими нейронами розробленої на основі багатошарової нейронної мережі. 2 q2 2 Винахід складається з вхідного сенсорного шару нейронів i i 1 n , що містить керуючі , 5 h 1,p та вихідного шару Y j 1,m, a також з N проміжних шарів: шару Z q 1 g з керуючими нейронами R h 1, p , шару Z q 1 g з керуючими , , нейронами R h 1, p ,…, шару Z q 1 g з керуючими нейронами , R h 1, p R ^. Кожен нейрон вхідного шару i 1, n пов'язаний з кожним нейроном Z -шapy вихідними зв'язками W i 1 n; q 1 g , а також кожен з керуючих нейронів , , R h 1 p пов'язаний з кожним нейроном Z - шару вихідними зв'язками , W h 1 p ; q 1 g , де верхні індекси зв'язків - це номер проміжного шару, з яким , , нейрони 1 q1 R 0 h0 0 1 0 j 1 h1 1 2 h2 2 N qN 2 N N N 2 N i 1 11 iq1 1 1 1 0 h0 0 12 h0q1 15 1 1 N hN 10 1 0 0 0 1 1 з'єднує матриця зв'язків та номер самої матриці відповідно, перший індекс 1 показує, що нейрони вхідного шару з'єднані з нейронами першого проміжного шару, другий індекс: 1, коли матриця з'єднує обробляючі нейрони X - шару з обробляючими нейронами першого проміжного 1 шару Z , і 2, коли матриця з'єднує керуючі нейрони X - шару з обробляючими нейронами 1 1 2 першого проміжного шару Z . Кожен нейрон Ζ - шару пов'язаний з кожним нейроном Z - шapy вихідними зв'язками h 1,p ; R 1 1 h1 1 p 1 , h Wh22 2 1q 1 1 21 Wq1q2 q1 1 g1; q2 1 g2 , а також кожен з керуючих нейронів , , пов'язаний з кожним 2 нейроном шapy Z вихідними зв'язками (k+1) q2 1 g2 . По аналогії кожен наступний Ζ - шар пов'язаний з наступним Ζ , k - шаром вихідними зв'язками (k Wqk qk1)12 qk 1 gk ; qk 1 1 gk 1 та кожен керуючий нейрон , , R k h k 1, p k hk 20 з пов'язаний кожним нейроном Z (k+1) шapy вихідними зв'язками ( Whkkq21)2 hk 1 pk ; q2 1 g2 , де перший верхній індекс зв'язків показує, що нейрони k-го , , 25 шару пов'язані з нейронами шару (k+1), другий індекс: 1, коли матриця з'єднує обробляючі k (k+1) нейрони шару Z з обробляючими нейронами проміжного шару Z , і 2, коли матриця з'єднує k (k+1) керуючі нейрони проміжного шару Z з обробляючими нейронами проміжного шару Z . Ν Нейрони останнього проміжного Ζ - шару пов'язані з кожним нейроном вихідного Y-шару вихідними зв'язками N WqN1j qN 1 gN ; , пов'язаний з кожним нейроном Y- шару вихідними зв'язками 30 35 j 1 m та кожен керуючий нейрон R N h N 1, p N , hN N WhN2 hN 1 pN ; , j j 1 m . , Розроблена мережа функціонує відповідно до двох алгоритмів: навчання й розпізнавання. Алгоритм навчання являє собою процес визначення навчального набору зображень та побудови матриць вагових коефіцієнтів. Навчання проводиться з використанням навчального набору зображень. Процес навчання реалізовується в формі обчислень, це означає, що спочатку обчислюються вагові матриці по відомих формулах [1]. Вагові зв'язки для зв'язку першого сенсорного шару та першого проміжного шару розраховуються за формулами: L Wd0 q1 S 0 S 1, d0 1 n p 0 , q1 1 g1; (1) , , d q 1 S d0 i S rh0 , (2), де W d0q1 - вагові зв'язки; 40 S 0 S 1 - пари асоціативних зображень; - номер пари d q асоціативних зображень; L - загальна кількість пар асоціативних зображень; rh0 - керуючий вектор. В загальному вигляді формула має вигляд: L Wdk q( k 1) S 0k S 1(k 1) , dk 1 qk pk , q( k 1) 1 g( k 1) ; (3) , , d q 1 2 UA 108712 C2 S S rhk (4). dk qk Для біполярних вхідних зображень функції активації fр(Uвx.p) для елементів X- і Y-шарів задаються виразом: Uвих .р 5 10 15 1, якщо Uвх.р t p , t 1 Uвих .р t , якщо Uвх.р t p , (5) 0 , якщо U t вх .р p де Uвx.ν Uвих.ν - вхідні та вихідні сигнали ν-гo елемента, θр - поріг р-го елемента, p 1 L . , Приклад навчання мережі з біполярними нейронами для запам'ятовування двох асоціативних зображень на вхідному шарі, чотирьох - на першому проміжному шарі, вісьмох - на другому проміжному шарі та шістнадцятьох - на вихідному шарі з урахуванням керуючої інформації, представлених фіг. 2. Всі запам'ятовувані образи можна представити двійковими біполярними векторами, які показані в таблиці 1, де вхідний вектор - це вектор, що подається на сенсорні нейрони вхідного шару, керуючий вектор 1 - вектор, що подається на керуючі нейрони вхідного шару, асоційований вектор 1 - вектор, що отримується на виході першого проміжного шару, керуючий вектор 2 - вектор, що подається на вхід керуючих нейронів першого проміжного шару, асоційований вектор 2 - вектор, що отримується на виході другого проміжного шару, керуючий вектор 3 - вектор, що подається на входи керуючих нейронів другого проміжного шару, асоційований вектор 3 - вектор, що отримується на виході вихідного шару нейронів. Таблиця 1 - Набори асоціативних зображень, представлених двійковими векторами Вхідний вектор 1 1 S = (1,1,1,1.1, 1,1,1,1,1,1 ,1,1,1,1,1, 1,1,1,1, 1,1,1,1,1,1 ,1,1,1,1) Асоційований вектор 1 Керуючий (виходи вектор 1 першого проміжного шару) 2 3 1 S 11 = (1,1,1,11,1,1,1,1,1,1, r11 = (1,-1,-1,1, 1,1) 1,1,1,1,1,1,1, 1,1,1,1,1,1,1,1,1,1,-1) Асоційований Асоційований Керую Керуючи вектор 3 (виходи вектор 2 (виходи чий й вектор третього другого вектор 2 3 проміжного проміжного шару) шару) 4 5 6 7 1 S 21 = (-1,1,1,1,1 S 31 = (-1,1,1,1,1,1, 1,1,1,1,r21 = (1,1,1,1,1,1, 1,1,1, 1,- r31 = (1,1,1,-11,1,1,1,-1,1, 1,1,1,1,1,1, 1, 1,-1-1) 1,1) 1,1,1,1,1,-1, -1,1,1,1,1,1,-1, 1,1,-1,-1, 1,-1-1) 1,1,1,-1) 1 r32= (-1, 11,1-1) 1 S 22 = (-1,1,1,1,1,1,1,1,1,1,1, r22= (-1,r = (1,1,1,1,1,-1,1,1,1, - 31 1, 1,1,-1) 1,1-1,-1) 1,1,1,1,1,1,-1, 1,1,1-1) r32 = (-1, 1,-1,1,-1) 3 S 32= (-1,1,1,1,1,1,1,1,1,1, 1,1,1,1,-1,1, 1,1,1,1,-1, 1,1, 1,-1,-1,1,1,1,-1) 1 S 33 = (-1,1,1,1,1,-1,1,1,1,1,1,1,1,1,1,1,1,1,1,-1,1, 1,1,1,1,-1,1,1,1,1) 1 S 34 = (-1,-1,1,1,-1,-1,1,1,1,1,1,1,1,1,1,-1, 1,1,1,-1,1,1,1,1, 1.-1,1,1,1,-1) UA 108712 C2 Продовження таблиці 1 1 S 12 = (1,1,1,1,1,1,1, 1,1,1,-1, r21= (-1,1, r12= (-1,1,-1,1,-1) 1,1,1,-1,-1,-1.1) 1,1,1, 1,1,1,1,1,1,1,1, 1,1,1) 1 S 23 = (-1,1,1, 1,1,1,1,1,1,1, 1,1,1,1,-1,r31= (1,-1, 1,1,1,1,1,-1,-1) 1,1,1,1,1,1,1,1,1, 1,1) 1 S 35 = (-1,1,1,1,1,1,1,1,1,1,1.1,1,1,-1,1,1,1,1,1,1,1,1,1, 1,1,1,1,1,-1) 1 S 36= (-1,1,1,1,r32= (- 1,1,1,1,1,1,1,1,1,1,1,1,1,-1,1,1, 1,1,1,1,-1,-1) 1,1,1,1,1,1,1,1,1,1) 1,1,1,1) 1 S 24 = (1,1,1,1,1,1,1,1,1, = (-1,-1,1, 1,-1, 1,1,1,-1,- r31= (1.-1. 1,-1) 1,1,1,1,1,-1,-1) 1,1,1,1,1,1,1,1,1.1,-1) 1 S 37 = (-1,1,1,11,1,1,1,1,1,1,1,1,1,-1,1,1,1,1,-1,1,-1,1,-1,1,-1,1,1,1-1) 1 S 38 = (-1,-1,1, 1,-1,-1,1,1,1, -1,r32=(1,1,1,1,-1. 1,1,-1,1,1,1,1,1,-1,1,1, 1) 1,1,1,-1,1,1,1, -i) 2 S = (1,1,1, 1,1,1,1,1,1 , 1,1,1,1,1,1 r11= (1,-1, ,1,1,1,1,1,- 1,1) 1,1,1, 1,-1,1,1,1,1,-1) 2 S 11 = (1,1,1,1,1,1,1,1,1,1,1, -1,r21=(-1,1,1,1,1,1, 1,-1,1) 1,1,1,1,1,1,1,1,1,-1,1,1,1,1,-1) 2 S 21 (-1,1,1,1,-1,1,1,1,1,1,1,1,1,1,1, r31= (1,-1, 1,1,1,1,1,1,-1,-1) 1,1,1,1,1,1,1,1,1,1) 2 S 31 = (-1,-1,1,1,-1,-1,1,1,1, 1,1,1.1,1,1, 1,1,1,1,1,-1, 1,1,1,-1,-1, 1,1,1,-1) 2 r32= (1,1,-1,1,1) 2 r22=.(-1,1,1,1,-1) S 22 = (-1,1,1,1,1,1,1,1,1,1, r31= (1,1,1,1,1,-1,1, 1,1,-1,-1) 1,1,1,1,-1,1,1, 1,1-1,1,1, 1,-1) r32=(1,1,-1,11) 4 S 32 = (-1-1,1,-1,1,-1,1,1,1,1,1,1,1,1,1, 1,1,1,1,1,1,1,1,1,-1,-1,1,1,-1,-1) 2 S 33 = (-1,1,1,1,1,1,1,1,1,1, 1,1,1,1,1,1,1,1,1,1,1,1,1, 1,-1,-1,1,1,-1,-1) 2 S 34 = (-1,-1,1,1,-1,-1,1,1,1,-1,1,1,1,1,1,1,1,1,1,1,1,1,1,1-1,1,1,1,1,-1) UA 108712 C2 Продовження таблиці 1 2 S 12 = 2 (1,1,1,1,1S 23 = (1,1,1,1,11,1,1,1,1,1,1,1,r31= (1,r =К 1r12= (-1,1-1,1-1) 1,1,1,1,1,1,1,1 21 1,1,1,1,1,1,1,1,1, 1, 1,-1,1,-1,1) ,1,1,1,-1, 1,1,-1,1,1,1,-1,-1,- 1) 1,1,1,-1,-1, 1,1,-1,-1) 1,1,1,-1) 2 S 35 = (-1.1.1.1,1,-1,1,1,1,1,1,1,1,1,1,1,1,1,1,-1, 1,1,1,1,-1,-1, 1,1,-1,-1) 2 r32= (1,1,-1,1,1) 2 r22=(-1,1,1,1,-1) S 24 = (1,1,1, 1,1,1,1,1,1,-1,1,1,1,1,r31= (1, 1,1,1,1,1,1,1,1,-1,-1) 1,1,1,1,-1,1,1,1,1,-1) r32=(-1, 1, 1,1,-1) 5 10 15 20 25 30 S 36 = (1,1,1,1,1,1,1,1,1, -1,1,1,1,1-1, 1,1,1,1,1,1,1,1,1,-1,-1,1,1,-1,-1) 2 S 37 = (-1,1,1, 1,1,-1,1,1,1,-1,1,1,1,1,1,1,1,1,1,1,1,1,1,1,-1,-1,1,1, 1,-1) 2 S 38 = (1,1,1,1,1,1,1,1,1,-1, 1,1,1,1,-1, -1, 1,1,1,-1,-1, -1, 1,1,-1,-1, -1, 1,-1,1) Побудова вагових матриць між сенсорними нейронами або нейронами, що визначають асоціації, одного шару та нейронами, що визначають асоціації, наступного шару здійснюється за формулою (1), побудова вагових матриць між керуючими нейронами одного шару та нейронами, що визначають асоціації, наступного шару здійснюється за формулою (2). Побудовані вагові матриці представлені в таблицях (фіг. 3-8). Джерела інформації: 1. Дмитриенко В.Д., Корсунов Н.И. Основы теории нейронных сетей. - Белгород: БИИММАП, 2001. - 159 с. 2. Пат. 18624 України МПК G06G 7/00. Пристрій двонаправленої асоціативної пам'яті / Дмитрієнко В.Д., Заковоротний О.Ю.; замовник та власник патенту Національний технічний університет "Харківський політехнічний інститут". - № u 2006 05460, заявлено 19.05.2006; опубліковано 15.11.2006, Бюл. №11. 3. Гібридна ієрархічна нейронна мережа для зберігання знань технологічного процесу механообробки / Дмитрієнко В.Д., Хавіна І.П. // Вісник НТУ "ХПІ". Тематичний випуск: Інформатика та моделювання. Харків: НТУ "ХПІ". - 2013. - №39 (1012). - С 68-72. ФОРМУЛА ВИНАХОДУ Пристрій багатошарової асоціативної пам'яті з керуючими нейронами, який складається з двох сенсорних шарів нейронів вхідного й вихідного, (N-1) проміжних шарів обробляючих нейронів, кожен нейрон вхідного шару з'єднаний з кожним обробляючим нейроном першого проміжного шару вихідними зв'язками, кожен обробляючий нейрон кожного проміжного шару з'єднаний з кожним обробляючим нейроном наступного проміжного шару вихідними зв'язками, кожен обробляючий нейрон останнього проміжного шару з'єднаний з кожним нейроном вихідного шару вихідними зв'язками,який відрізняється тим, що у вхідний та всі проміжні шари обробляючих нейронів введені керуючі нейрони, кожен керуючий нейрон вхідного шару з'єднаний з кожним обробляючим нейроном першого проміжного шару вихідними зв'язками, кожен керуючий нейрон кожного проміжного шару пов'язаний з кожним обробляючим нейроном наступного шару вихідними зв'язками, кожен керуючий нейрон останнього проміжного шару пов'язаний з кожним обробляючим нейроном вихідного шару вихідними зв'язками. 5 UA 108712 C2 6 UA 108712 C2 7 UA 108712 C2 8 UA 108712 C2 9 UA 108712 C2 10 UA 108712 C2 Комп’ютерна верстка Г. Паяльніков Державна служба інтелектуальної власності України, вул. Урицького, 45, м. Київ, МСП, 03680, Україна ДП “Український інститут промислової власності”, вул. Глазунова, 1, м. Київ – 42, 01601 11

ДивитисяДодаткова інформація

Автори англійськоюZakovorotnyy Oleksandr Yuriiovych

Автори російськоюЗаковоротный Александр Юрьевич

МПК / Мітки

МПК: G06F 15/18, G06G 7/60, G06N 3/08

Мітки: асоціативної, пам'яті, пристрій, нейронами, керуючими, багатошарової

Код посилання

<a href="https://ua.patents.su/13-108712-pristrijj-bagatosharovo-asociativno-pamyati-z-keruyuchimi-nejjronami.html" target="_blank" rel="follow" title="База патентів України">Пристрій багатошарової асоціативної пам’яті з керуючими нейронами</a>

Попередній патент: Сполуки триазолопіридину як інгібітори фосфодіестерази pde10a

Наступний патент: 2-тіопіримідинони

Випадковий патент: Спосіб одержання екстракту кореневищ гірчака зміїного, що має протимікробну активність відносно поліантибіотикорезистентних штамів умовно-патогенних мікроорганізмів